在当今云计算技术飞速发展的背景下,Docker作为一种轻量级的容器化技术,已成为构建、部署和管理云原生应用的核心工具。它为云计算装备技术服务提供了标准化、可移植和资源高效利用的解决方案。本文将探讨在云服务器环境中,如何高效配置和管理Docker,以最大化其技术优势。

一、 核心优势:为何Docker是云计算的理想搭档

- 环境一致性:Docker容器将应用及其所有依赖项(库、配置文件等)打包成一个标准化的单元,确保了从开发、测试到生产环境的完全一致,彻底解决了“在我机器上能运行”的经典难题。这对于跨多个云服务器节点的分布式部署至关重要。

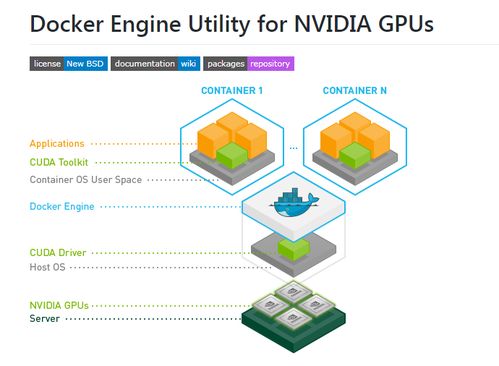

- 资源高效与敏捷性:与传统虚拟机相比,Docker容器共享主机操作系统内核,无需为每个应用加载完整的操作系统,因此启动速度极快(秒级),资源开销(CPU、内存)极低。这使得在云服务器上可以高密度地部署更多应用实例,快速响应业务弹性伸缩需求。

- 微服务架构的天然载体:云计算常与微服务架构结合。Docker容器是封装和隔离单个微服务的理想单元,便于独立开发、部署、扩展和更新,极大地提升了复杂云应用的敏捷性与可维护性。

二、 关键配置实践:优化云服务器上的Docker环境

在云服务器上配置Docker,需从安全、性能和存储等多维度进行优化。

- 安装与基础配置:

- 使用官方源或云服务商提供的优化镜像进行安装,确保版本稳定与安全更新。

- 创建专用的

docker用户组,将运维人员加入,避免使用root用户直接操作,提升安全性。

- 配置Docker Daemon启动参数,例如调整日志驱动(如

json-file并设置日志大小轮转)、设置默认的容器运行时(如使用containerd)。

- 存储与数据持久化:

- 配置合适的存储驱动(如

overlay2),以获得更好的性能。

- 对于需要持久化的数据(如数据库文件、应用日志),务必使用Docker卷(Volumes) 或绑定挂载(Bind Mounts),而非容器内部存储。在云计算环境中,可以结合云服务商提供的块存储或文件存储服务(如AWS EBS、阿里云云盘、NAS)创建卷,实现数据的持久化与高可用。

- 网络配置:

- 根据应用架构,灵活运用Docker的桥接网络、覆盖网络(Overlay Network,适用于跨主机集群)或Macvlan网络。

- 在云服务器集群中,常使用

overlay网络实现跨主机的服务发现与通信。

- 妥善映射容器端口到宿主机,并利用云服务商的安全组或防火墙规则进行精细化的访问控制。

- 资源限制与监控:

- 使用

docker run命令的-m、--cpus等参数,或在Compose文件中定义资源限制,为容器设定CPU、内存的使用上限,防止单个容器耗尽云服务器资源,影响其他服务。这是多租户云环境下的必备实践。

- 集成监控工具(如

cAdvisor结合Prometheus和Grafana),实时监控容器及云服务器的资源使用状况、性能指标和健康状况。

- 安全加固:

- 以非root用户运行容器内部进程(使用

USER指令)。

- 定期扫描镜像中的安全漏洞(使用

docker scan或第三方工具)。

- 启用Docker内容信任(DCT),确保镜像来源可信。

- 保持Docker引擎及主机操作系统内核的及时更新。

三、 进阶管理:结合编排工具实现云原生运维

单台服务器的Docker管理是基础,云计算的核心在于集群化与自动化。

- 使用Docker Compose定义多容器应用:对于由多个关联容器(如Web应用、数据库、缓存)组成的服务栈,使用

docker-compose.yml文件进行声明式定义和统一管理,简化了在单机或小型集群上的部署流程。

- 拥抱容器编排平台:在生产级云计算环境中,Kubernetes已成为容器编排的事实标准。通过Kubernetes,可以:

- 自动化容器的部署、扩展(水平与垂直伸缩)、滚动更新与回滚。

- 实现跨多个云服务器节点的负载均衡与服务高可用。

- 管理服务发现、配置与密钥。

- 云服务商普遍提供托管的Kubernetes服务(如GKE、EKS、ACK),极大降低了集群管理的复杂性。

- 集成CI/CD流水线:将Docker镜像构建与云服务器部署流程整合到持续集成/持续部署(CI/CD)管道中(如Jenkins、GitLab CI),实现代码提交后自动构建镜像、安全扫描、推送至镜像仓库并部署到云服务器集群,全面自动化云服务交付。

四、

在云计算装备技术服务体系中,正确、高效地配置和管理Docker是释放云平台弹性、敏捷与成本效益的关键。从单机环境的优化配置,到集群级别的自动化编排与运维,Docker与云计算的深度融合,为现代应用的构建与交付提供了坚实的技术基石。运维团队应持续关注最佳实践,结合具体业务场景与云平台特性,构建安全、稳定、高效的容器化云服务环境。